(関連:ヤン・セントヴァーナー、モーリッツ・サイモン・ガイスト、ラシャッド・ベッカー、グレッグ・フォックス、センサリー・パーカッション、スクエアプッシャー、ブラム・シュタッドハウダー、アクトレス+ヤング・ペイント)

義手のための触覚技術の研究をしているというシッディーに出逢ったのは、フェスのために出掛けたある旅先のゲストハウスでだった。同じフェス目当てで街にやってきた年頃の近い女の子同士ということで、私達はすぐに仲良くなった。音楽好きのシッディー、サックスも吹くミュージシャンということだったが、バリバリ理系の才女。仕事は何しているの、という話から、シッディーの研究の話を聞かせてもらうことになった。手を失った人のために、触覚を持った人工皮膚の技術開発をしている研究室に在籍してそこで実験の日々だと言う。ロボット義手の技術が既に存在すること自体、知らなかった私にとっては、その義手から感覚をフィードバックさせて脳で操作するなんて、SFの世界、夢のまた夢みたいな話であった。

「念じると動くの?信じられない。」

「そう、ファントムリムって知ってる?肢体を失っても、腕や足を持っている感覚は、残るの。」

「うん、それはなんか聞いたことある。」

「それは神経のせいなんだけど、その失った肢体の神経を義手につないで、動かすというところまでの技術は出来ているの。(へえ!)でも、義手で柔らかいものを持った時に握りつぶしてしまっては意味がないし、熱いものを持って高価な義手を壊してしまう危険性もある。だから、触ったものが、硬い、柔らかい、熱い、などの感覚を脳にフィードバックさせないことには、ロボット義手の実用化はまだ難しいの。触覚を持った人工皮膚の開発を、私の研究室はしていて…」

触覚を持った人工皮膚、そんな技術が開発されようとしている話に少し頭がクラクラした。サイエンティストなのにサックスも吹くとか、素敵だね。と言うと、彼女の知っているサイエンティストは、みんな音楽好きで(特にジャズ)、そして楽器をやっている人が多いという。頭のいい人は器用で羨ましい。

サイエンスと音楽の関係性について、その時はそれ以上あまり深く考えることはなかった。

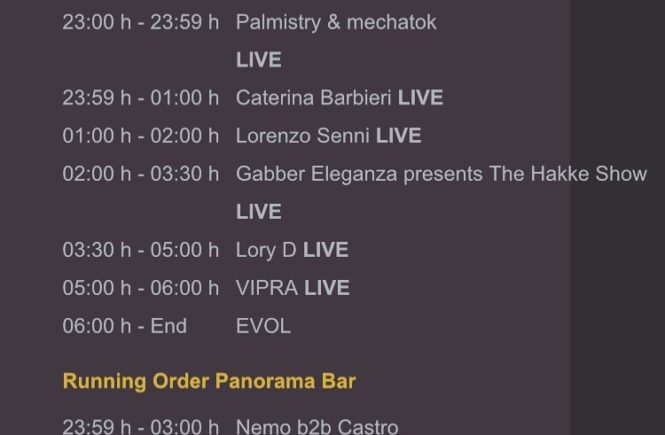

先日、ベルリンのHaus den Kulturen den Welt(直訳すると世界の文化の家、以下HKW)というホールでMouse on Marsが、Dimensional People Ensembleという新しいプロジェクトによる公演を行った。この新しいプロジェクトは、ソニックロボットを含む50人以上とも言われているミュージシャンをコラボレーターに迎えたビッグバンド・アンサンブルで、MoMの11作目のアルバムのタイトルでもある。テクノ、ヒップホップ、ジャズ、アンビエント、ポップ、ロックと様々にジャンルを超越した音が同居しているこのアルバム。音になんだかリベラルな雰囲気を匂わせるのもそのはず、どうやらこのアンサンブルのメンバーにはベルリンで行われた2016年のPEOPLEプロジェクトに集まったミュージシャンの名前が並ぶ。アルバム作成の経緯については英語だとこのページ、日本語だとこのページをお読みになれば更に詳しく分かる。

(ちなみに2018年のPEOPLEは、既成概念を覆す謎めいたフェスティバルとしてベルリン市民によく知られる所となった。タイムテーブルやどんなバンドがどんな演奏を行うかは一切告知されず、その代わりに出演アーティスト総勢160名の名前がずらりと並ぶウェブサイトと、街中に貼られたシンプルなポスター。行った人にしかその全貌は分からない。筆者はチケットが高いのも影響して行かない選択をしてしまったが、これが会場であるFunkhausの唯一残念なところ。)

これだけの個性のある多数のミュージシャンを一つの楽曲にまとめ上げる策として、様々なパートを自在に組み合わせて再構築出来るようにスコープが必要だった。

「ルールを予め2つだけ決めておいたんだ」と、ヤンセントヴァーナー教授は説明する。「作品を通じて145くらいのBPMでいきたいと思っていたので、それでリズムのスキームというベースがあった。それから、特定のキーも定めた。このルールを決めておくことで、誰とどんな音を録っても、後で前後に動かしたり組み合わせたりできるという仕組みだ。何をやってもつじつまが合う、許される。」

https://www.nytimes.com/2018/03/12/arts/music/mouse-on-mars-dimensional-people-mit.html

一体どんな公演になるんだろう。HKWでの公演に先立ち、MoMの片割れJan St. Wernerが、Rashad BeckerやドラマーのEli Keszlerと共に、ベルリンのもう少しアンダーグラウンドな会場ACUD Macht Neuでソロを披露するというので、予習の意味も込めて観に行くことにした。David Luciani、Jan St.Werner、Rashad Beckerがそれぞれエレクトロニクスのソロを披露した後、Eli Keszlerのドラムとエレクトロニクスのパフォーマンスというライナップで構成されたこの夜。開始時刻の20:00ギリギリに会場に到着すると、総勢200人くらいだろうか、ACUDはほぼキャパ一杯、満員の観客で賑わっていた。

余談だが、Jan St.Wernerのコミカルでクレイジーなパソコンを使ったライブ中に、オーディエンスに居た相方アンディー・トマがくすっと笑う瞬間を私は見逃さなかった。電子音が犬の鳴き声の様に聴こえる部分があり、それが可笑しかったと後で教えてくれた。私はてっきりフィールドレコーディングをサンプリングしているものだと思ったのだが、トマに聞くと合成音だとのこと。初めから終わりまで何をやっているのか、さっぱりわからなかったと話すと「分かるはずないよ」と笑うトマ。でも、なんかファニー、ということで観客の感想は一致していたと思う。

Rashad BeckerのContinuum Fingerboardという鍵盤のないシンセサイザーを組み込んだ抽象的で瞑想的でマイクロトーナルな演奏が続いた。Continuumとは時空連続体という意味。音階に縛られることなくXYZの三つの軸の中の三次元空間を自在に操る楽器で、なんだか理論はテルミンと似ている。最近手に入れた新しい機材で、楽しく研究中とのことだが、ラシャッドの音楽によく親和する楽器だと思った。

そして、先立つ電子楽器のライヴ中も、ずっとステージの背後にスタンバイしていたアコースティックドラムセット。生ドラムが三度の飯より好きな私は、ワクワクと待ちかねていた。最後に登場したのが、NYのエクスペリメンタルドラマーのEli Keszler(イーライ・ケスラー)だった。打面に布をかけて消音したスネアやドラムヘッドの上に並べた小さなシンバルなどを、トラディショナルグリップ(左手が鉛筆持ちでジャズドラマーに多い叩き方)で繊細に即興のドラムパターンを叩き出す。即興演奏の面白みとは、その場所と時間にしか存在しない一過性の魔力を、音がまとうことだと思う。同時性の時間芸術である音楽。空間の反響、観客の立てる音や外の騒音、その時の気分、他のメンバーがいればその他のパートとの駆け引きなど、いろいろな突発性と偶然性に、音楽が語りかけ、音楽に変換して内包し、音楽を通じて宇宙の理を仕立て上げるかのような。ハプニングである。魔力である。だが、イーライは何もかもを飲み込むように繊細な生のドラム音以外に、もう一つ魔力を使った。生ドラムの音に加わるエレクトロニクスの音のレイヤーだ。

音としては、こんな風に聞こえた。フリージャズのドラムストロークに、完璧なタイミングで重なり合うエレクトロニックな合成音。完璧なタイミングなのは、アコースティックドラムを叩いたその動作が、トリガーになっているからだ。でも、単なる振動/マイクによるトリガーではない。イーライがアコースティックドラムのヘッド(皮)またはリム(ふち)のどの位置を、どんなストロークの強さで、スティックを重ねる叩き方、ヘッドを押し込んで叩いたかなど、学習して認識した超高性能・次世代トリガーだ。結果は想像を超える幅の音の可能性!ちなみに、演奏中に彼は一度もパソコンに触れることは無かった。

これは実は、センサリー分野の最新テクノロジーで、ドラムの可能性を広げた最新音楽なのだ。Sensory Percussion(センサリーパーカッション)というのが、この演奏を可能にしたセンサーとソフトウェアのプログラムの名前である。

キックスターターでのファンディングを経て2016年頃に完成したこのプログラムの開発に、開発者Tlacael Esparzaの友人としてベータ段階から関わっていたGreg Fox(グレッグ・フォックス)の2017年秋の演奏で、私はこのセンサリー技術を使ったライヴを初めて体験した。その時、グレッグに聞いた話についてちょっと触れる。日本に居る人は、この来日公演で彼の演奏を知っているかもしれない。

「僕のドラムの先生は面白いレッスンをしてくれる人だったんだ。彼の地下室にあるスタジオに行くと、ドラムセットの前に座って受けるようなレッスンとは全く違うことを教えられた。先生は僕の心臓にマイクを取り付けて、それをアンプリファイしたり、引き伸ばしたり、速度を速めたりするという実験をして見せてくれた。この作業を少し続けると、知り得る限りのありとあらゆるビートが、自分の心臓の音から聴こえてくるということがわかる、面白い実験だ。(心臓の音がトリップホップを刻んでるなんて不整脈じゃないの?、と笑いつつグレッグの健康を気にかけたのだが、そういうことではないらしい。)このことから、音楽を聴く人もプレイする人も誰もが持っている心臓−この心臓を持っている以上、誰もがリズムを理解できるしドラムだって叩けるという勉強になった。誰もが自分の体内にリズムを持っている、という証明だ。…それから、ドラマーとして、今でも続けている練習方法に、こんなのがある。正確なタイム/タイムを無視した叩き方、意識的/無意識的な叩き方、この2極の概念をXとY軸に据えて紙に十字を書くと、4つのエリアが現れる。その4つのエリアを満遍なく、同じくらいの時間だけ練習するんだ。すなわち、タイムを正確に意識を集中して、タイムを無視しながらも叩いていることに集中して、無意識だけどタイムを正確に、そして全く無意識でタイムも無視して、この4つのプレーンを行ったり来たりする。」

だいぶ話は逸れたが、グレッグ・フォックスの話は面白かった。彼の使っている最新プログラム、センサリー・パーカッションの話も面白かった。要は、いかにこの新しいセンサーとソフトウエアが、ドラマーとしての自分のプレイの可能性を広げる面白い道具かというのが、伝わってくる話だった。そんな話を聞いていたせいで、こういう事が出来るトリガーが(電子ドラムを除いて)、今まで存在していなかったのが、機材について無知な私にも分かった。やっぱりアコースティックドラムの良さというのは、電子ドラムに到底とって変わらない。たくさんのドラマーがこのプログラムを使い始めているのが、センサリーパーカッションでタグ付けされたフィードを見てみれば分かるかもしれない。有名所では、Son Luxのドラマー(これもNYのバンド)が下記のような作品を公開している(Youtubeへリンク)。それから、このプログラムの詳しい仕組みについては、Sunhouse社のkickstarterページをどうぞ、ご参照。

ACUDでのこの夜からイメージが浮かんだキーワード:センサリー、学習機能、身体(心臓)のエレクトロニックによる拡張!

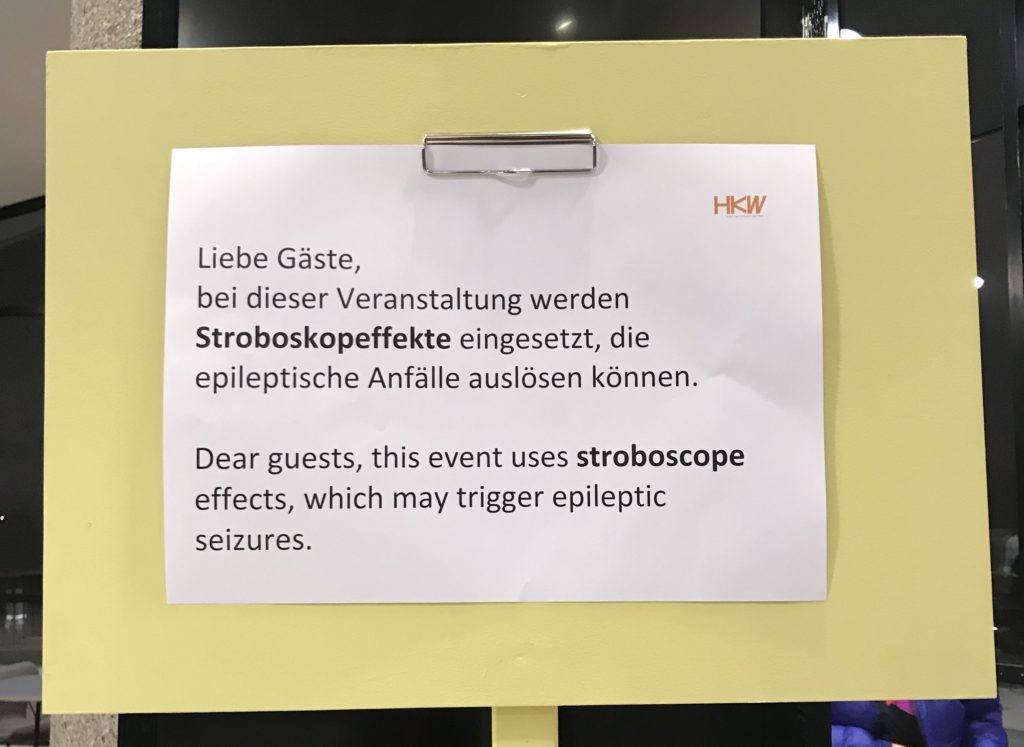

さて、ACUDから2日後のこの夜が、HKWでのMouse on Mars – Dimensional People Ensemble公演だった。TECHNOSPHÄRENKLÄNGE(テクノシュシュフェーレンクレンゲ、直訳:球体的テクノ音)というコンサートシリーズの一環。どうやらテクノロジーと音楽をテーマにした主催内容だ。前半は、ダンサーとセンサーとキネティックロボットを組み合わせたコンテンポラリーダンスで、見応えがあった。休憩を挟み、セット転換を眺めながら、ホールの座り心地の良い席に腰掛け公演の開始を待った。「激しいストロボの光を使った演出のため、健康上心配な方はご留意ください」という張り紙がしてあるのや、配られたパンフレットを読みながら始まるのを待っていた。

照明が落ち、まさに始まる直前、私はiphoneを機内モードに設定…しようとした所、Siriが誤動作をし、画面読み上げを始めてしまった。徐々に静まり始めていた客席、慌ててSiriを黙らせるベく操作する。恥ずかしいながらも、なんかこの公演のテーマに合っているロボットボイスを偶然聞かされることになり、テクノロジーとまさに隣り合わせで生きている事についてちょっと考えさせられる。

ホールの電気が完全に落ちると、真っ暗い無人のステージでキネティックソニックロボットが、ビカビカと光ながら打楽器を奏で始めた。そこへ1人また2人と人間の出演者が登場し、音に加わる。最初に登場したのは、トロンボーンとサックスのブラスセクションだったと思う。それからパーカッション/ギターのDodo NKishi(ドド・ニキシ)、アンディーとヤン、ドラマーのAndre Belfi(アンドレア・ベルフィー)が登壇し、曲に参加していく。キネティックに動くソニックロボットをプログラミングするMoritz Simon Geist(モーリッツ・サイモン・ガイスト)と、ライティング 担当のMatthias Singerもいつの間にかステージにいる。後で登場したシンガーのSwamp Dogg(スワンプドッグ)を除いて、この8名が、今回のアンサンブルをベルリンで披露してくれたメンバーだ。そして、ステージ上に散らばるたくさんのソニックロボット達。カツカツとか、ポクポクと音を立てるもの、スネアに取り付けられたもの、吊るされたシンバルを鳴らすもの、ゴングの横でスタンバイしてるもの、など。ロボットなので表情はないが、叩いた瞬間に光るストロボをそれぞれが持っていて、自己主張している。どんな音楽だったかはアルバムを聴いて想像してもらうしかない。トランペッターのZach Condon(ザック・コンドン)とドド・ニキシとアンディが、それぞれ全然違うスタイルで時々歌う。色々なスタイルのミックスで、何とは言えない感じ。声、管楽器、ギター、パーカッション、ストリングス、エフェクトとサンプリング。それからソニックロボットの組み合わせ。ロボットまでもを仲間にした、リベラルなジャムだった。ポップでジャム、エクスペリメンタルでエレクトロニックながら全体的に暖かく明るい。

印象的だったのは、ベルフィーのドラムセットの目の前に設置されたソニックロボットが、一番特徴的なリズムを刻んでいたため、人間対ロボットの構図が強調されているように感じられた事。そして相変わらず何を操作しているのか観ている者からは(少なくとも私にはきっと一生)分からないが総指揮者セントヴァーナー教授の役割。笑。プログラムには名前の載っていたチェロ奏者が不在だったため、ストリングス部分も教授が担当した。コンピューター片手に床に置いたバイオリンを弾く。公演を終えて拍手を浴びる出演者の写真がこちら。

アンディー・トマの顔にマイクが被っており、本当に申しわけない。ちなみにアンディーにはもう一つ申し訳ないことを筆者はしており、アンディーの顔を知らなかった故に公演前にHKWのロビーに居た彼に向かって、あれれ今日もお会いしましたね!スタッフなんですか?と話しかけてしまった。超失礼、恥ずかしい。でも、笑ってくれた優しいアンディー・トマ。

この1週間で観た2つのコンサート体験で、アナログドラムが触覚と学習機能を持ち始めたということ(ちなみに、2018年はドラムセットの発明100周年記念だそうで、100年でここまで来たかというため息。これからも末長い繁栄を願う。)それから、人間がロボットと一緒にジャムし始めているという事を耳を持って体感し、ちょっと驚愕。

ちなみに、スクエアプッシャーが自動演奏ロボットZMachineと作った作品’Music For Robots’というのあるが、実は自動演奏というのは、全然新しい技術ではない。何故かといえばオルゴール。自動演奏ロボットはオルゴールよりもっと複雑なんだという反応があるとすれば、100年前の自動演奏オルガンを例にあげたい。ドラムまで組み込まれた、もはやバンドとしか呼びようがないダンスオルガンと呼ばれる自動演奏オルガンが存在していた。オランダの Bram Stadhouders (ブラム・シュタッドハウダー)はこの歴史的な自動演奏オルガンをギターその他の楽器でMIDI信号に変換してトリガーして、ヨーロッパ各地のジャズフェスティバルなどでインプロ演奏をして見せている。複数の奏者にパートを割り当てることも可能で、私が観る機会に恵まれたMoers Festivalでの演奏では、キーター奏者のTalibam!のMatt Motel(マット・モーテル)がドラム部分をキーター(鍵盤とギターから成る造語でちょっとバカにされがちな楽器だが、マットはこの楽器にこだわる)で超楽しげに演奏していて、観ているこちらも面白かった。

だが、ここで触れたマシンとは、結局は演奏しているのは人間で、ロボットを操って操作しているに過ぎないじゃないか。ロボットが意思を持って奏でるような音楽は?という疑問に、鋭い人にはActress(アクトレス)の新しいプロジェクト、アーティフィシャル・インテリジェンスのYoung Paint(ヤングペイント)を思い浮かべるだろう。ヤングペイントについて、随分調べてみたのだが、語られている内容はごくわずかだ。10年間にわたるアクトレスの音楽制作の特徴を学習したプログラムということ以外には、わからなかった。ベルリンでは年明け2019年のCTMフェスティバルでこれが観れるということなので、そこで何か気づくことがあればまたレポートしたいと思う。研究者のシッディーの話から想像すると、ロボットが人に触れた時に暖かさを感じる日はもうすぐ来る。だけどフィードバックされた暖かいという感覚が変換されるのは、プログラムし意図された、意味、感情、音色。それとも…。果たしてこれからの、AIヤングペイントの学習はいかに?

音楽もテクノロジーも、その可能性は、人が想像する限りに無限に拡張していく。だけど、義手を作ってどうしたいの、というのを突き詰めると、その答えは「完全になりたい」という事なんだと思う。余談であるが、「あなたはすでに完璧」と泣きたくなる、とってもシンプルな、ほぼアナログセッティングで凄いパフォーマンスをするドラマーを昨夜見たので、後日レポートしたいと思う。(終)

Eli KeszlerのACUD Macht Neuでの写真はフォトグラファーのMarcellina Wellmerに提供してもらいました。無断転載禁止。彼女の他の写真はこちらのサイトでも見られます。 marcelinawellmer.com / Instagram